https://www.linkedin.com/feed/update/urn:li:activity:7370684035574071296/

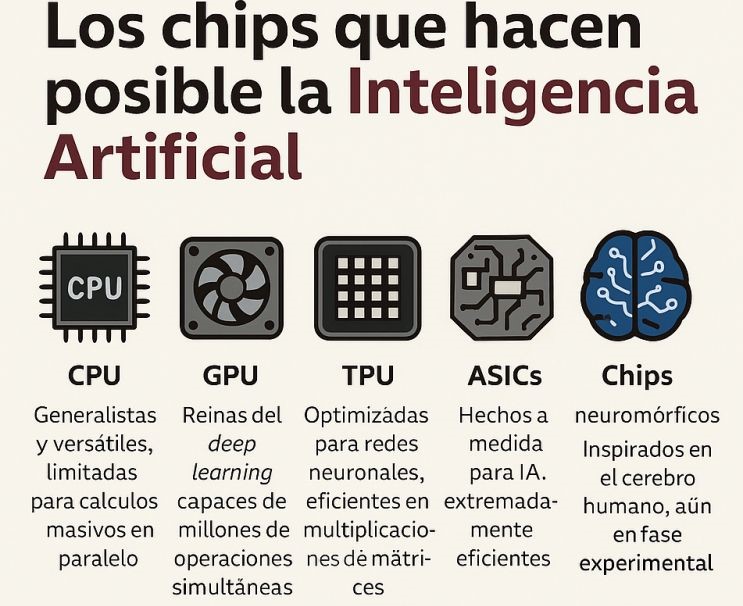

🚀 Los chips que hacen posible la Inteligencia Artificial 🤖💾

🎯 Cuando hablamos de IA, pensamos en algoritmos, datos y modelos… pero detrás de todo eso late un corazón de silicio. Sin los chips adecuados, no habría ChatGPT, coches autónomos ni sistemas de visión artificial.

💡 La clave: no todos los chips son iguales. Para entrenar y ejecutar redes neuronales se necesitan arquitecturas muy distintas de las que usan los procesadores clásicos.

🔎 Tipos de chips para IA:

CPU 🖥️ → Generalistas, versátiles, pero limitadas para cálculos masivos en paralelo.

GPU 🎮 → Diseñadas originalmente para gráficos, hoy son las reinas del deep learning. Capaces de realizar millones de operaciones simultáneas.

TPU ⚡ → Procesadores creados por Google, optimizados para multiplicaciones de matrices, el núcleo de las redes neuronales.

ASICs 🔧 → Chips hechos a medida para IA, extremadamente eficientes, pero menos flexibles.

Chips neuromórficos 🧠 → Inspirados en el cerebro humano, aún en fase experimental, pero prometen un salto radical en eficiencia energética.

📈 La magnitud del cambio es brutal:

✔️ Un solo GPU de última generación puede realizar más de 1 billón de operaciones por segundo.

✔️ El consumo energético de entrenar un modelo de IA puntero equivale al gasto de decenas de hogares en un año.

✔️ Los chips especializados ya mueven un mercado que superará los 200.000 millones $ en 2030.

🎯 En definitiva: la carrera por la IA también es una carrera por el hardware. Las arquitecturas que se diseñen hoy marcarán qué modelos serán posibles mañana.

💬 ¿Crees que los chips neuromórficos llegarán a sustituir a las GPU en el futuro?